Библиография от GPT: границы достоверности

Светлана Александровна МОРОЗОВА, заместитель директора Фундаментальной библиотеки Российского государственного педагогического университета им. А.И. Герцена (Санкт-Петербург)

Предыдущие два года мы рассказывали о том, как библиотекари могут сами применять GPT-модели и обучать пользователей их корректному и компетентному применению*.

В 2025 г. в российском научном публикационном пространстве (а в зарубежном с 2023 г.) массово обнаружились последствия применения больших языковых моделей — сгенерированные полностью или частично библиографические списки в научных рецензируемых изданиях.

«Хорошей» новостью оказалось, что фейковые ссылки — один из ключевых путей обнаружения сгенерированного текста, но это не умаляет проблему.

Как проанализировать библиографию на предмет наличия сгенерированных ссылок и на что следует обратить особое внимание?

* Морозова С.А. GPT-модели искусственного интеллекта, университетский библиотекарь и автор: создаём публикацию вместе / С.А. Морозова // Университетская КНИГА. 2025. № 1. С. 62–68. EDN DKWQHY; Морозова С.А. «Мы оба с ним как будто из металла, но только он — действительно металл», или Как перестать беспокоиться и начать использовать генеративные модели ИИ / С.А. Морозова // Университетская КНИГА. 2024. № 1. С. 42–49. EDN QRTNPV.

ЭТО НЕ ГАЛЛЮЦИНАЦИЯ

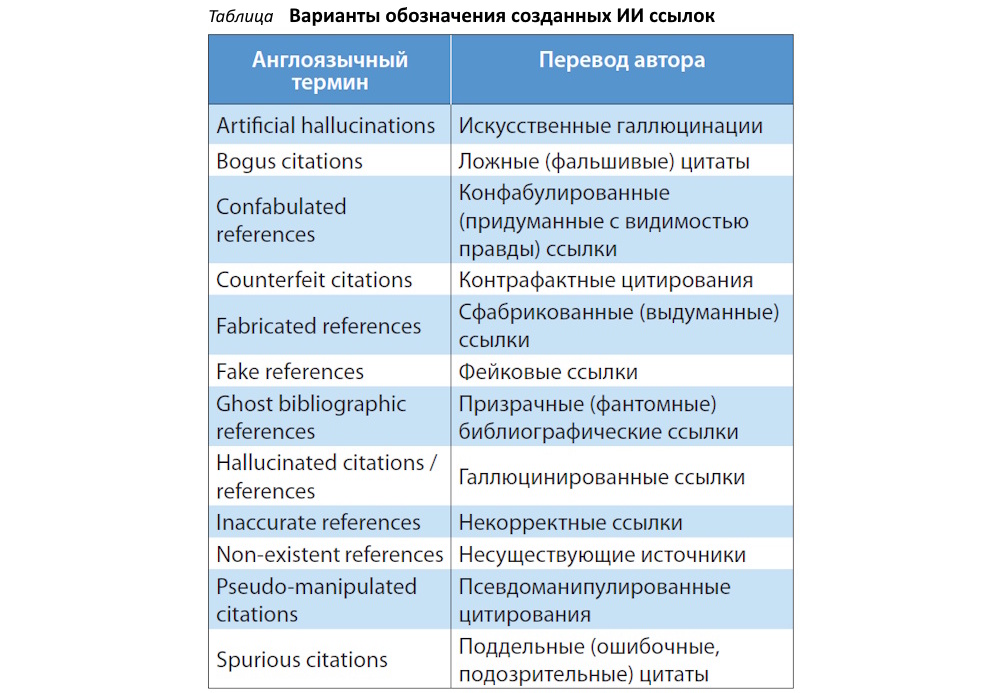

В зарубежных исследованиях, сфокусированных на созданных GPT ссылках и библиографических списках, состоящих из очень правдиво выглядящих ссылок на несуществующие публикации, можно обнаружить более 10 вариантов обозначения генераций с придуманной моделями информацией (таблица).

Топ-3 в этом перечне вариантов составляют Fabricated references; Hallucinated citations/references и Inaccurate references. Но наше внимание привлёк вариант Confabulated references, подробно описанный Дирком Спеннеманом в большом исследовании, которое было опубликовано весной 2025 г.¹.

¹ Spennemann D.H.R. (2025). The Origins and Veracity of References ‘Cited’ by Generative Artifi cial Intelligence Applications: Implications for the Quality of Responses // Publications. 2025. Mar. Vol. 13, iss. 1. Art. 12. https://doi.org/10.3390/publications13010012 .

Автор не считает корректным применять термин «галлюцинации» к результатам генераций GPT, которые выглядят правдоподобно, но, по сути, придуманы моделью. Понятие «галлюцинация» в психологии означает сенсорный опыт без внешнего стимула (зрения, слуха и т.д.). Таким образом, использование термина антропоморфизирует, гуманизирует модели ИИ, поскольку GPT не обладает сознанием, восприятием, не имеет ощущений, не «видит» и не «читает» научные статьи (модель скорее их изучает алгоритмически, создавая массив данных наравне с любыми другими видами информации).

Конфабуляция в нейропсихологии означает непроизвольное создание правдоподобных, но ложных воспоминаний или фактов, чтобы заполнить пробелы в знании. Это происходит, например, при некоторых формах амнезии. Очень важное совпадение: в конфабуляции нет намерения обмануть: человек просто достраивает недостающее тем, что кажется ему правдивым. LLM-модели делают то же самое, утверждает Спеннеман: когда им не хватает информации, они «додумывают» её статистически, создавая правдоподобные, но ложные ссылки. Генерация ссылок на несуществующие публикации — это комбинация вероятных элементов, а не поиск фактов. В GPT (как это ни печально и как бы нам бы ни хотелось это в них видеть) нет внутренней модели истины, нет проверки фактов, есть только статистическое прогнозирование следующего элемента текста. Перефразируя: если составлен качественный промпт, в вашем взаимодействии с моделью сформирован подробный контекст, вы ведёте пошаговый диалог, предоставляете найденные вами материалы (которые модель может дополнить, имея ваши примеры), анализируете аспекты и отдельные сегменты, то риск того, что модель будет додумывать, заполняя непонимание в вашем взаимодействии конфабулированной информацией, снижается. В остальных случаях модель будет придумывать без намерения обмануть (как и в конфабуляциях человека), поскольку это, как резюмирует Спеннеман, естественный результат работы вероятностной языковой модели.

Вы видите лишь часть этого материала. Подпишитесь на электронную версию журнала или приобретайте его на Ozon